一、计算机视觉四种基本任务:

1、图像分类;

2、图像定位;

3、物体检测;

4、物体分割;

背后的机器学习任务:数据分类、数据回归;

实际上大部分任务都是两个:

数据分类:数据离散;

数据回归:数据是连续的;

二、经典方法:

Deformable parts model:

什么是NMS:一种post-processing方式;应用在所有目标检测里,用来删除多余的检测结果;

做法:把所有的检测结果按照分值从高到低排序,保留最高分数的box,那么保留和他距离上最近的box;

hard mining:在一个1mini-batch里,能让classifier混淆的sample,标记为hard example,用到下一轮的训练中;

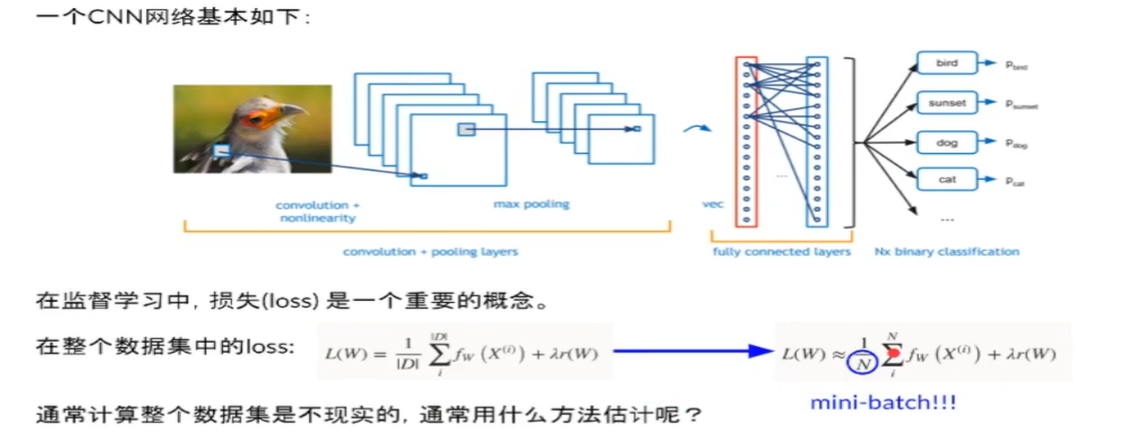

深度学习的快速回顾:

n一般为2、4,一般2就已经非常大了;

λ为正则化参数,防止过拟合;

深度学习三要素:

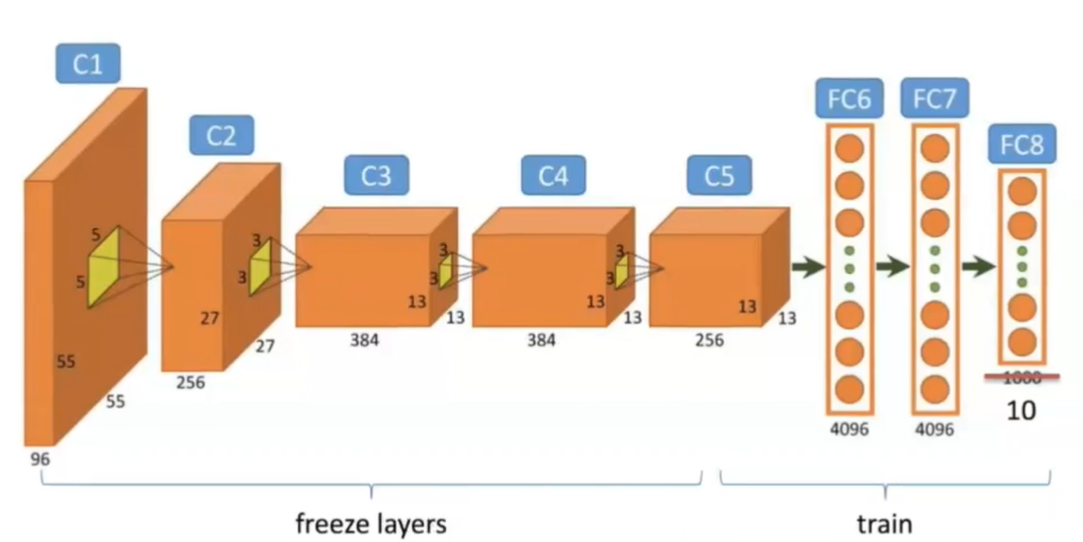

1、首先关注模型:用什么结构;

2、在什么数据集上做?实验效果如何;

3、算法:

a、训练过程:loss,sampling,梯度;

b、测试过程:muitl-scale,NMS;

3、系列工作

RCNN\Fast-RCNN\Faster-RCNN详细介绍;

目标分类的主要步骤:

1、先产生一些可能含有物体的目标框;

2、在给定的目标框里进行分类;

如何产目标框:

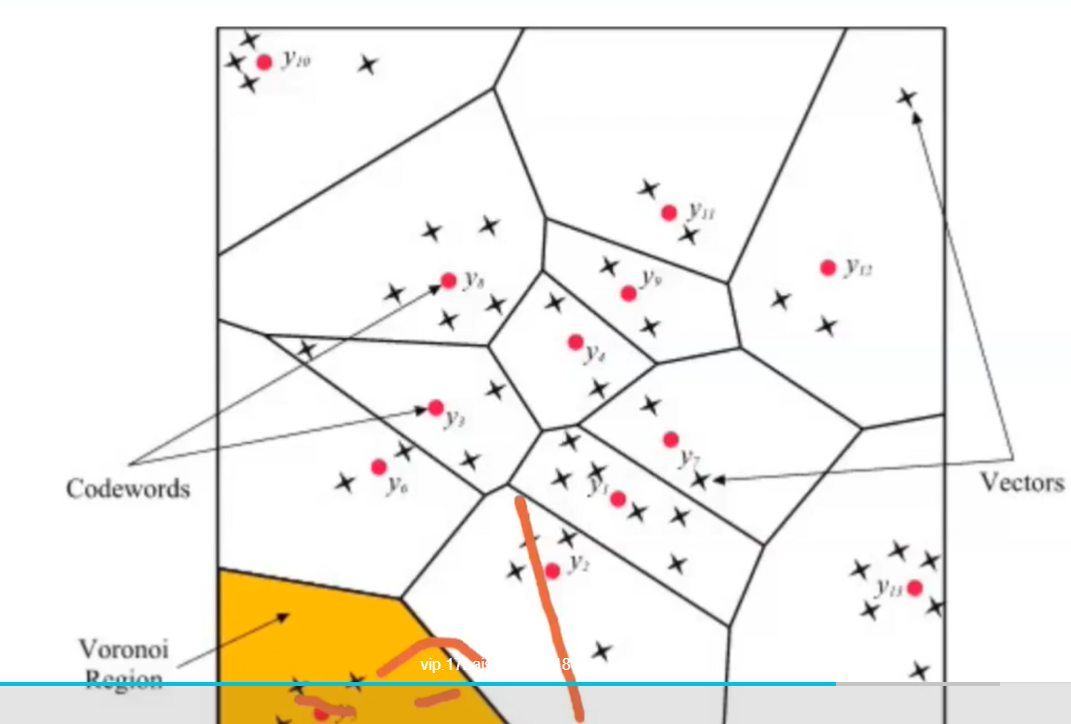

自下而上的一种生成方法:基于SLIC

算法,仙剑个图像分割成很多小的区域,根据小区域之间的相似程度进行融合,最后结合各个尺度上的结果,产生很多region proposals;

也可以通过深度学习来生成目标框;(主要用于faster ——RCNN中的目标框);

Rcnn家族

1、产生一个框: