1.Python程序由模块构成。每个模块以.py结束。

2.CTRL+s保存内容。

3.tab默认四个空格。

4.勤写注释。

5.使用\行连接符(一行代码太长)

1.Python程序由模块构成。每个模块以.py结束。

2.CTRL+s保存内容。

3.tab默认四个空格。

4.勤写注释。

5.使用\行连接符(一行代码太长)

import turtle

turtle.width(10)

turtle.color("blue")

turtle.circle(50)

turtle.penup()

turtle.goto(120,0)

turtle.pendown()

turtle.color("black")

turtle.circle(50)

turtle.penup()

turtle.goto(240,0)

turtle.pendown()

turtle.color("red")

turtle.circle(50)

turtle.penup()

turtle.goto(60,-50)

turtle.pendown()

turtle.color("yellow")

turtle.circle(50)

turtle.penup()

turtle.goto(180,-50)

turtle.pendown()

turtle.color("green")

turtle.circle(50)

1.python是一种解释型、面向对象的语言。

import turtle

turtle.showturtle() #显示箭头

turtle.write("fuzhuoming") #写字符串

turtle.forward(300)#前进300

turtle.color("red") #画笔颜色变红

turtle.left(90)

turtle.forward(300)

turtle.goto(0,50)

turtle.goto(0,0)

turtle.penup()#抬笔

turtle.goto(0,300)

turtle.pendown()

turtle.goto(0,50)

turtle.goto(50,50)

turtle.circle(100)

1.IDE:集成开发环境

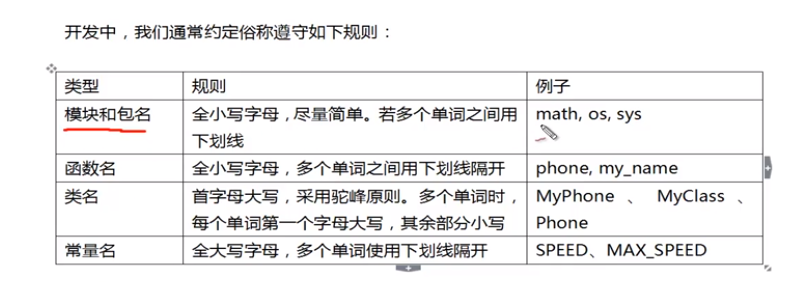

开发中,各类名称的定义

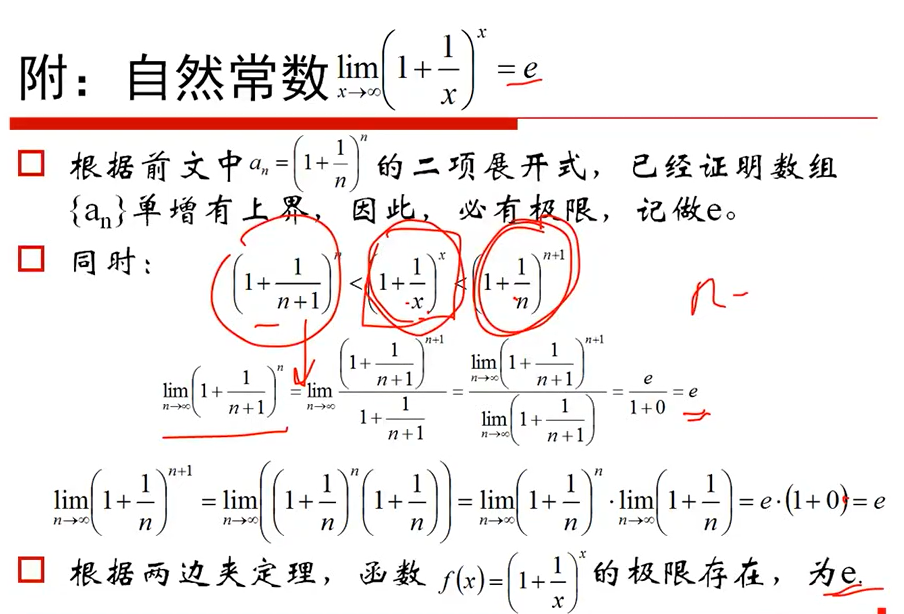

e

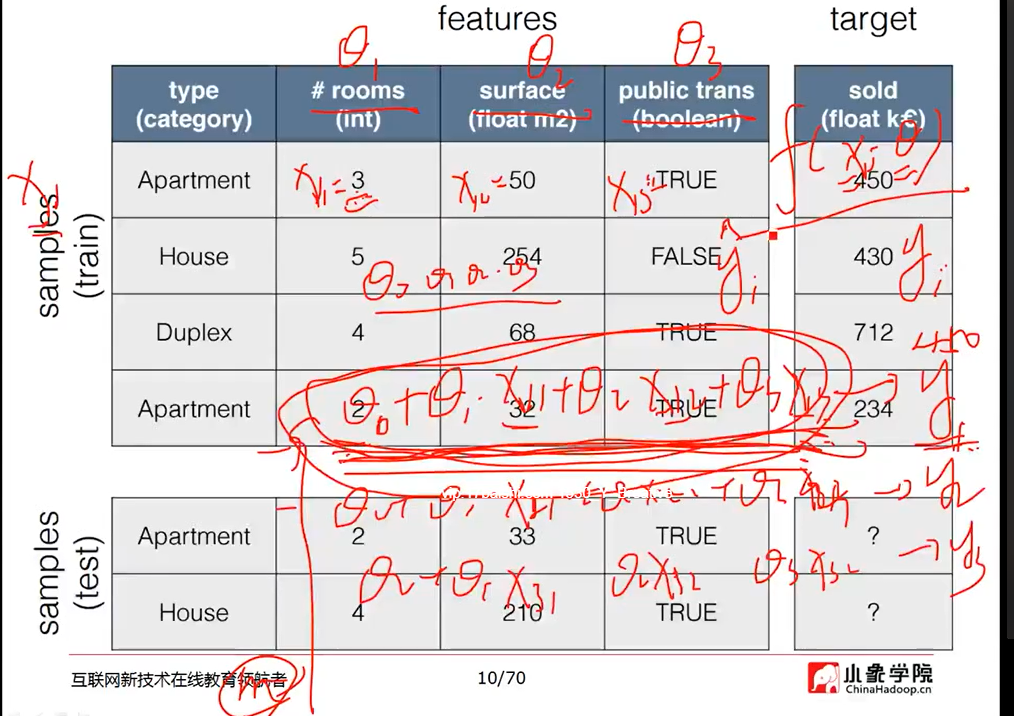

机器学习:使用计算机设计一个系统,使它能够根据提供的训练数据按照一定的方式来学习;随着训练次数的增加,该系统可以在性能上不断学习和改进;通过参数优化的学习模型,能够用于预测相关问题的输出。(强调学习 而不是专家系统)

有监督

无监督

强化学习(带反馈)

机器学习:数据清洗/特征选择;确定算法模型/参数优化;结果预测

不能解决:大数据存储/并行计算;做一个机器人

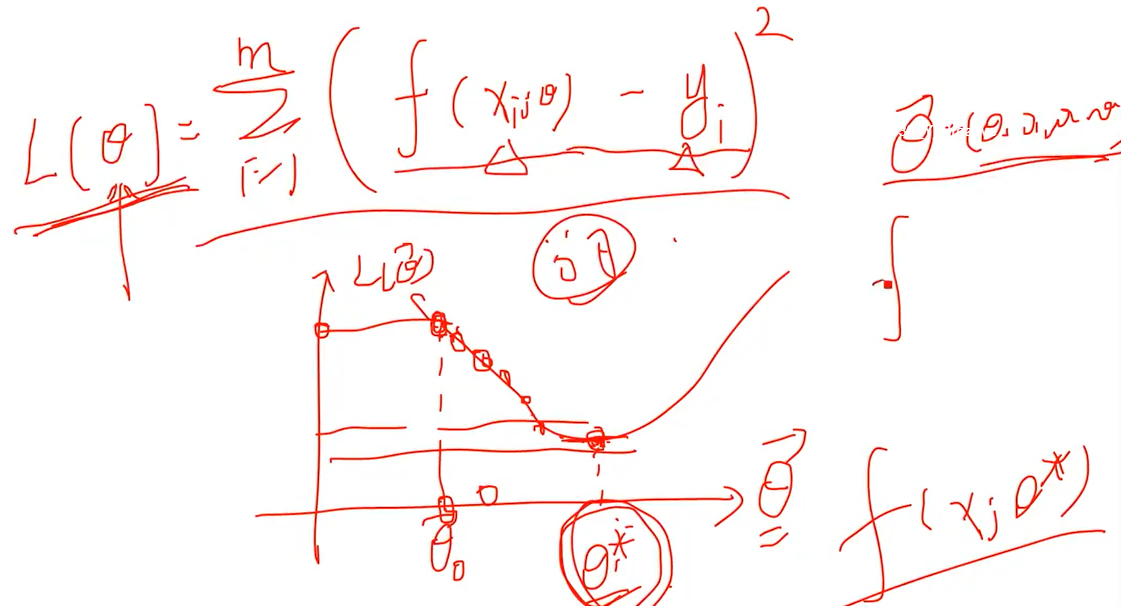

目标函数取最小称 损失函数

数据收集--->数据清洗----->特征工程----->数据建模

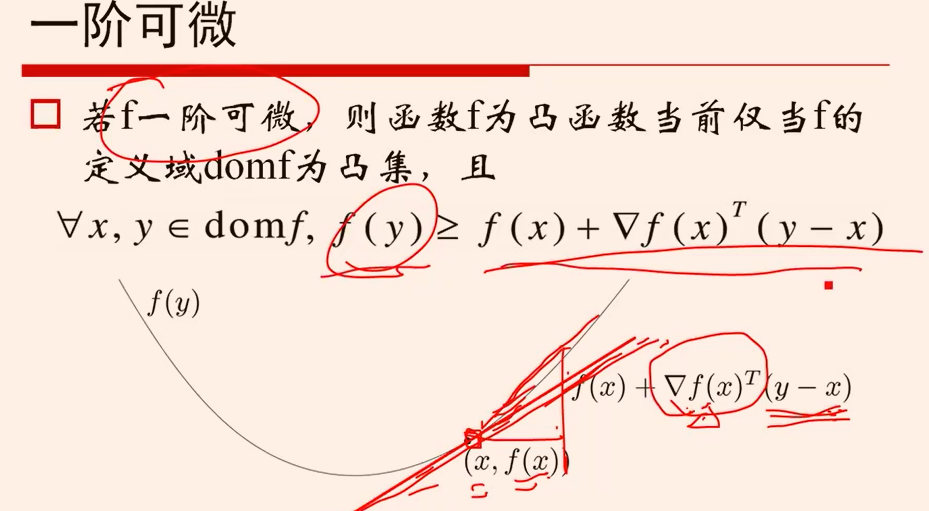

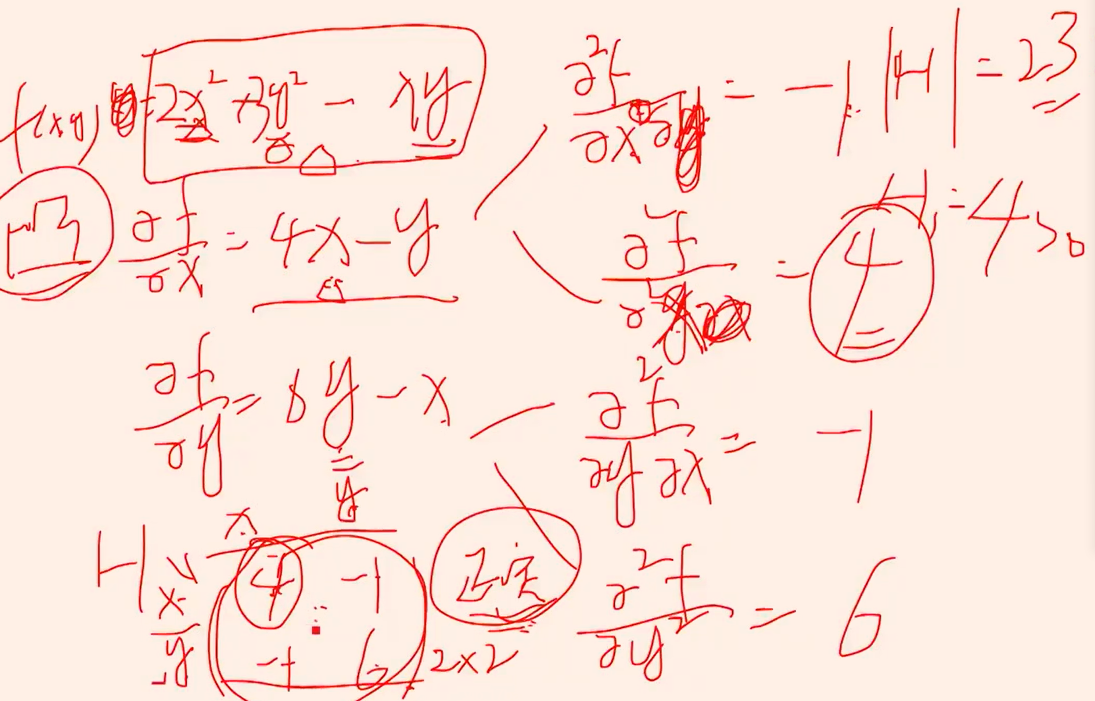

hessian矩阵 对称--》4>0 二阶行列式>0----》正定---->凸函数

偏移量包头不包尾

float(3)=3.0

float("3.14")=3.14

id+type(类型)+value(值)=对象

eg: 3 id:1531372336 type:int value:3

a:1531372336 #把地址赋给a

变量必须先被初始化,不然不能运行。eg:ddd 是不能运行会报错的。

F1快捷键,找出python的API

\ ——用于换行,也叫行连接符。

数据预处理

深度学习需要的是标准的正方形图片

(1)image resize

(2)Data Argumentation

(3)Normalize

(4)to tensor

自定义数据集实战

test数据量太小的话,测试结果波动较大,所以我们为了保证测试的效果,会把测试集的数据多分配一些

1、load data ——比较重要的模型;

继承一个通用的母类

inherit from torch.utils.data.Dataset

要定一个两个函数

_len_:数据量

_getitiem_:能够得到指定的样本

2、build model——在我们已经定义好的模型上做一些修改;

3、train and test

4、transfer learning

情感分类实战

Google CoLab

(1)continuous 12 hours;

(2)free K80 for GPU;

(3)不需要爬墙

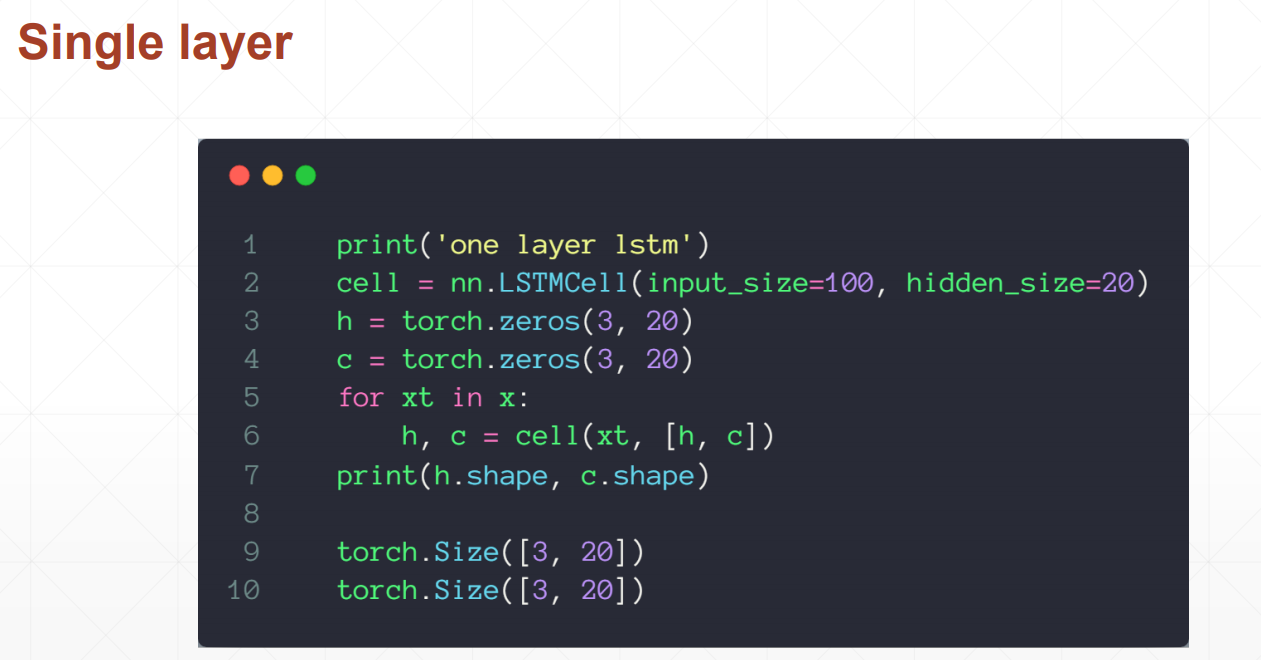

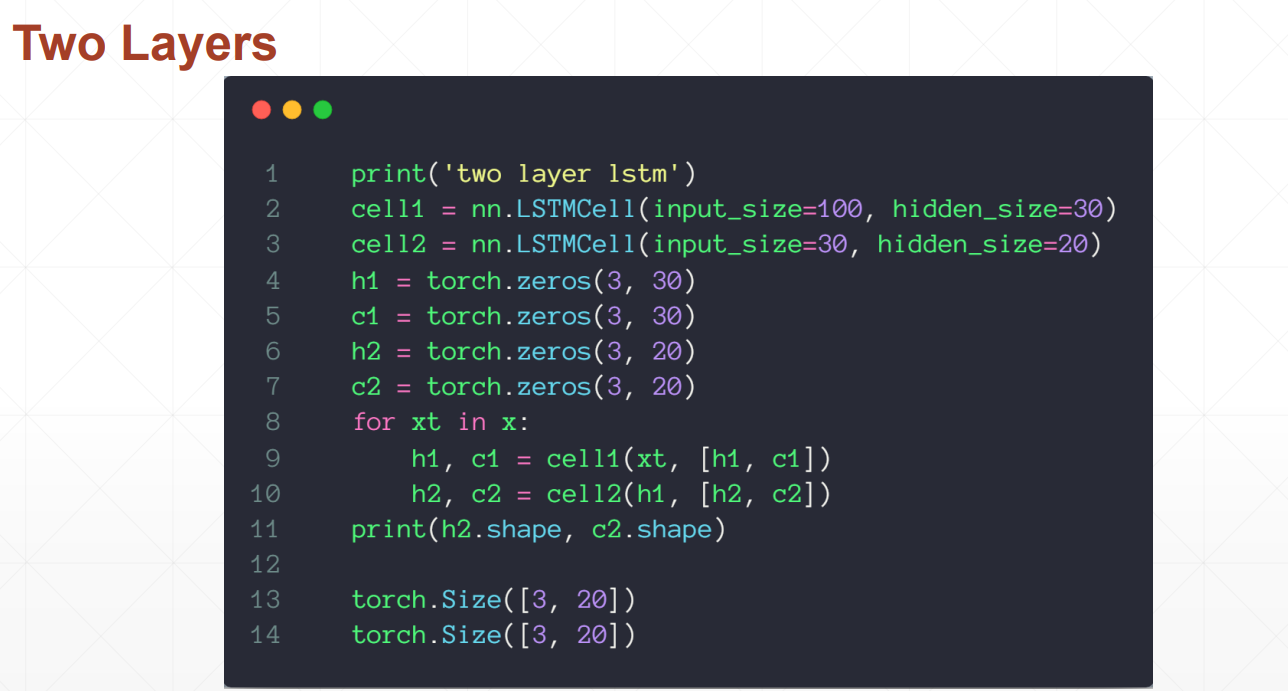

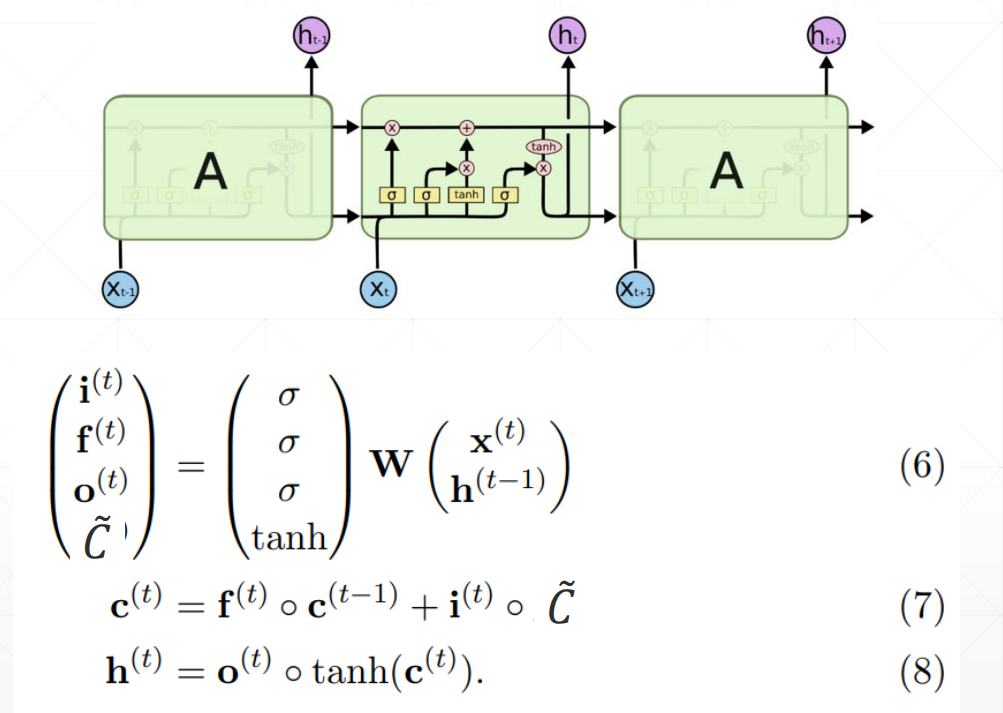

LSTM使用方法

LSTMcell更为灵活的使用方法,可以自定义喂数据的方式

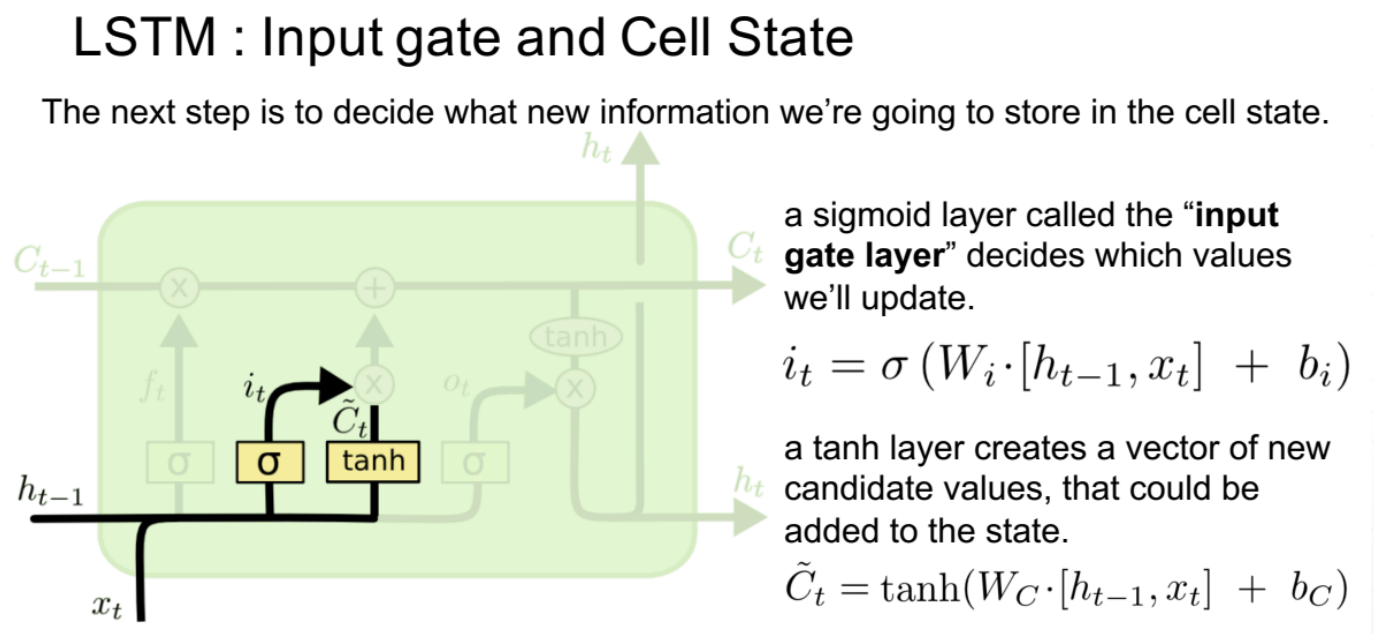

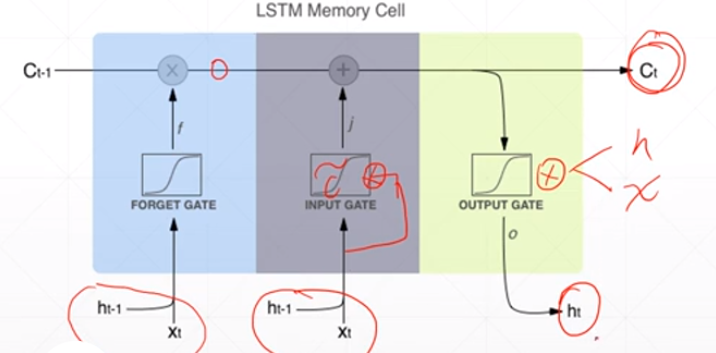

2、输入门

it作为一个开度,将多少信息传入到下一个时间点,有算法决定这个开度;新信息同样也是由ht-1和当前点的xt共同决定的。it是对当前信息的过滤系数,当前信息与开度相乘之后就是经过过滤后输入下一个点的新信息。

输入门的值

ct是memory,ht是隐藏层的输出

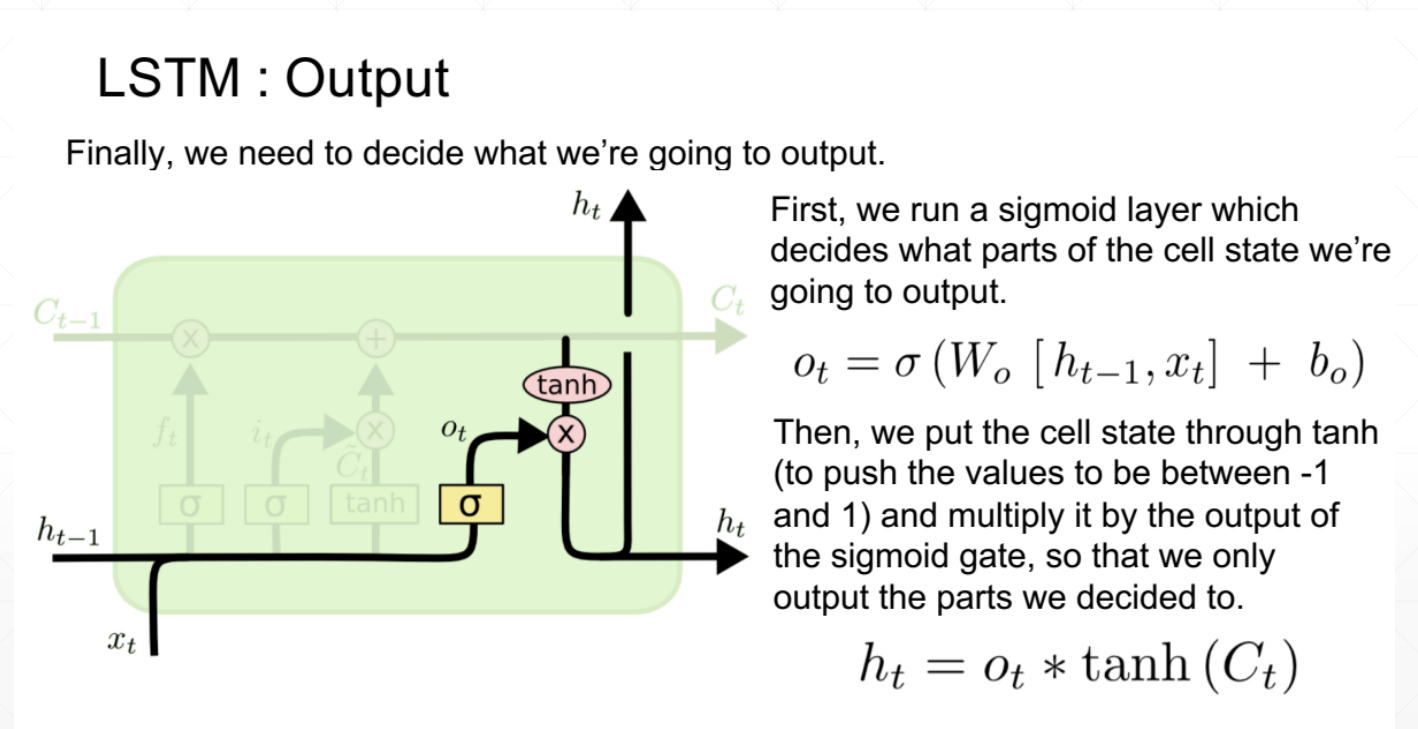

3、输出值

同样是由开度和ct共同决定的,ot作为开度也是由算法决定的

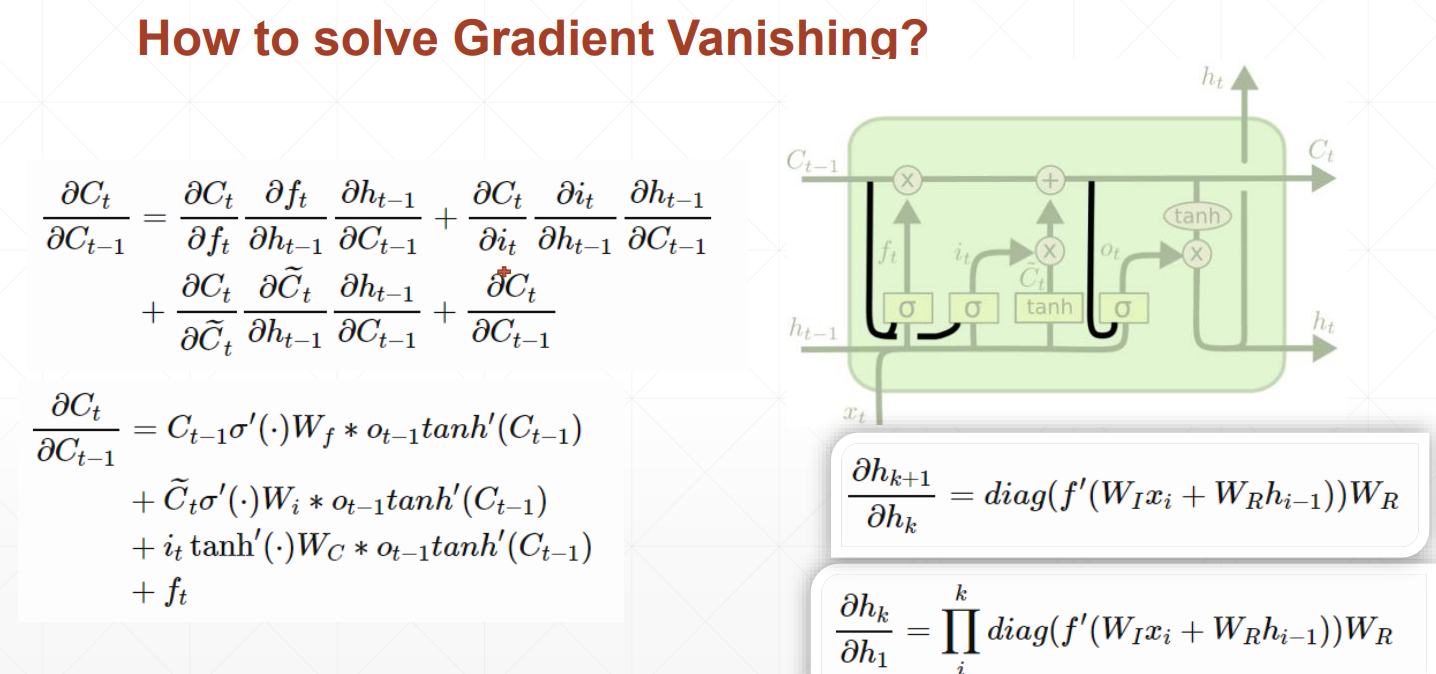

LSTM如何解决梯度离散的问题呢?

由于存在忘记门、输入门和输出门三个门

当前隐藏层对前一个隐藏层求导时,出现三个值相加的情况,不容易出现都是大或都是小的情况,数值相对可靠,所以效果相对来说更好一些。

LSTM将短期记忆变长,RNN只能记住比较短的时间序列,LSTM就是为了解决短期记忆的问题。

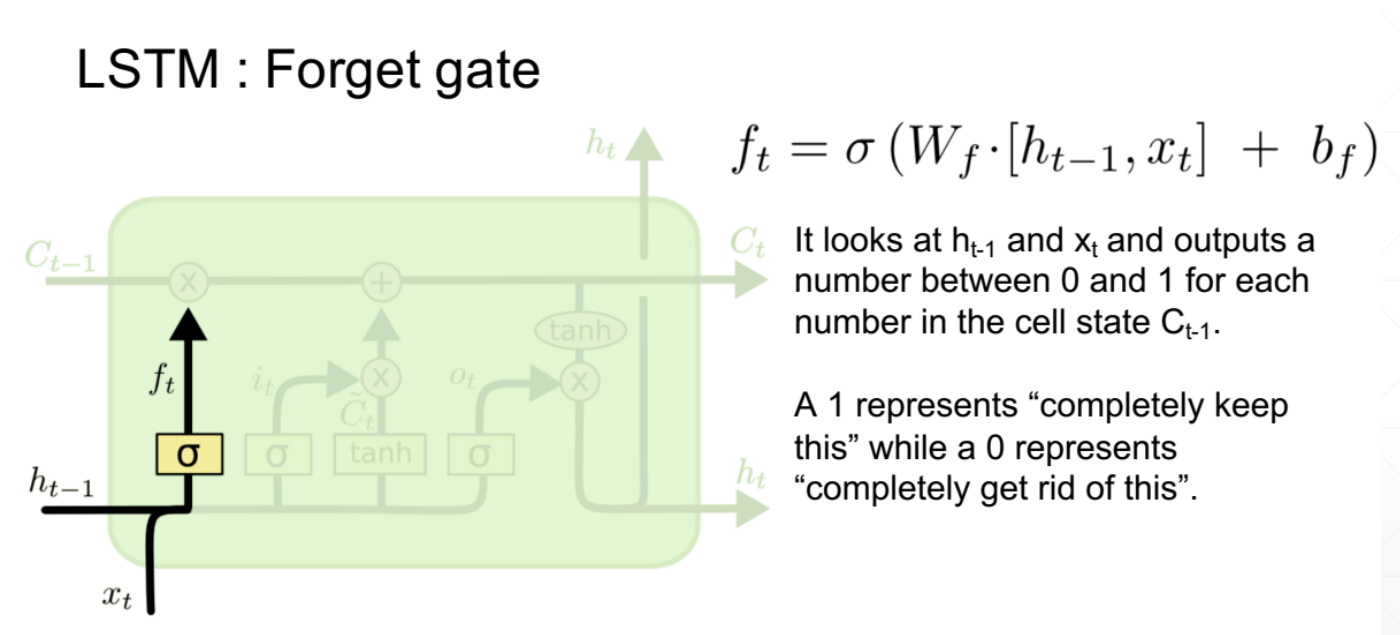

1、忘记门