SVD比PCA快得多

一、2个重要参数

1、svd_solver

"auto":数据量小选full,大则选randomized

"full":生成完整的矩阵,数据量不大一般选用

"randomized":适合特征矩阵巨大,计算量大。

"arpack”:适合特征矩阵大,一般用于特征矩阵为稀疏矩阵(每一列为0,1组成,大部分为0)

注:一般选"auto", 算不出来找"randomized"

2、random_state:

svd_solver为"randomized""arpack”生效,通常选"auto"

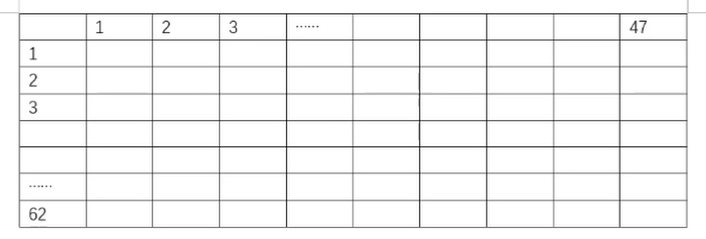

二、重要属性components_:提出的值是V(k,n),表示新特征空间,可视化可以看出提取了什么重要信息,n维压缩到k维